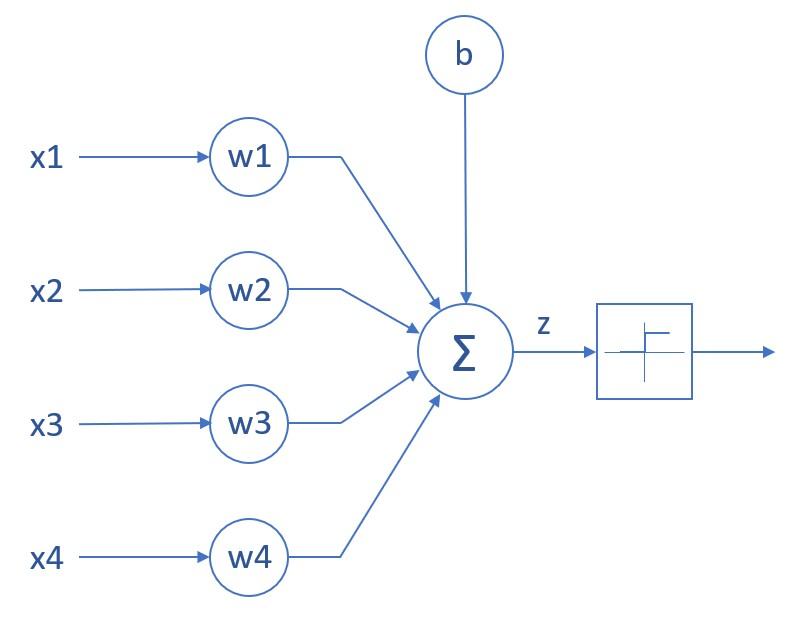

Recordemos el último esquema visto de la neurona artificial:

El resultado de la suma ponderada es -ya lo sabemos- la suma de cada valor de entrada, xi, por el peso del enlace asociado, wi, más el bias. Llamemos a este resultado "z":

z = w1.x1 + w2.x2 + w3.x3 + w4.x4 + b

Ahora bien, si consideramos el conjunto de valores de entrada a la neurona (xi) un vector:

x = (x1, x2, ..., xn)

...y el conjunto de pesos otro vector:

w = (w1, w2, ..., wn)

...llegamos a la conclusión de que la suma ponderada comentada puede también expresarse como el producto escalar del vector compuesto por los pesos y el vector compuesto por los valores de entrada (más el bias):

z = w•x + b

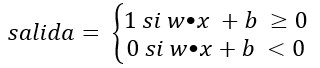

...lo que nos permite expresar algebraicamente el comportamiento de la neurona, por lo tanto, de la siguiente forma: